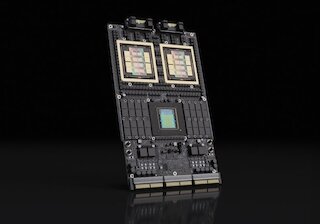

Kompakte Power für die Zukunft

Supermicro präsentierte neue WIO Server mit AMD EPYC™ 8005 Prozessoren auf dem MWC 2026Mit der Einführung der neuen WIO-Familie, bestückt mit den AMD EPYC 8005 Prozessoren, wurde eine Plattform für Edge- und Telco-Infrastruktur verfügbar gemacht. Die AS-1115S-FWTRT adressiert den Bedarf an Systemen, die Leistungsfähigkeit mit Blick auf Betriebskosten und Platzbedarf kombinieren.