NVIDIA GTC 2026 Keynote

NVIDIA läutet das Zeitalter der AI Factories ein – Die Highlights im Überblick

Die diesjährige NVIDIA GTC Keynote war weit mehr als eine bloße Produktshow – sie war ein strategischer Kompass für die Zukunft der KI im Unternehmen. Jensen Huang zeichnete das Bild einer neuen Ära, in der KI nicht mehr nur kommuniziert, sondern eigenständig handelt, komplexe Probleme löst und Entscheidungen vorbereitet.

Die Botschaft ist eindeutig: KI wird zur Kerninfrastruktur jedes Unternehmens. Die vorgestellten Technologien sind keine Experimente mehr für Forschungslabore, sondern produktionsreife Werkzeuge, die den unternehmerischen Alltag grundlegend verändern werden.

Für Ihre Praxis ergeben sich daraus vier zentrale Handlungsfelder:

- Agentische KI wird greifbar: Mit NeMo und OpenShell können Sie jetzt erste Pilotprojekte starten – sicher, kontrolliert und mit direktem Bezug zu Ihren Geschäftsprozessen.

- Die Infrastruktur wird skalierbar: Von der kompakten DGX Spark für agile Teams bis zur hochperformanten, flüssigkeitsgekühlten AI Factory – für jede Größenordnung gibt es die passende Lösung.

- Edge und Embedded gewinnen an Bedeutung: Wenn KI in der realen Welt agieren soll, braucht es robuste, sichere und latenzarme Plattformen – genau hier setzen die neuen Embedded-Lösungen an.

- Daten werden zum strategischen Vorteil: Die neuen Storage-Architekturen machen Ihre Datenbestände erst wirklich KI-tauglich und verwandeln sie von reinen Informationsspeichern in intelligentes Kapital.

Hier sind die relevantesten Ankündigungen für alle Unternehmen, die KI jetzt produktiv einsetzen wollen.

Die vielleicht wichtigste Ankündigung betrifft agentische KI. Mit OpenClaw hat sich in den letzten Monaten eine Plattform für KI-Agenten rasant verbreitet, die selbstständig Aufgaben planen und ausführen können.

Das Problem: OpenClaw allein war für Unternehmen oft zu riskant – es gab Sicherheitslücken und keine klaren Governance-Strukturen.

Hier kommt NVIDIA NemoClaw ins Spiel – ein Open-Source-Stack, der OpenClaw um das OpenShell-Runtime ergänzt. OpenShell schafft eine isolierte Sandbox-Umgebung, die kontrolliert, wann und wie Agenten auf sensible Daten zugreifen.

Was das für Unternehmen bedeutet:

- Erstmals können Unternehmen agentische KI-Systeme entwickeln und einsetzen – mit kontrolliertem Zugriff auf interne Daten.

- Die Agenten laufen lokal – auf eigener Hardware – und verlassen nicht das Unternehmensnetzwerk.

- Das Framework ist hardwareunabhängig, aber für NVIDIA-Plattformen optimiert.

Für regulierte Branchen wie Finanzen, Gesundheitswesen oder die öffentliche Hand ist das ein Game-Changer. Endlich gibt es ein Framework, das die Leistungsfähigkeit offener KI-Agenten mit der notwendigen Sicherheit verbindet.

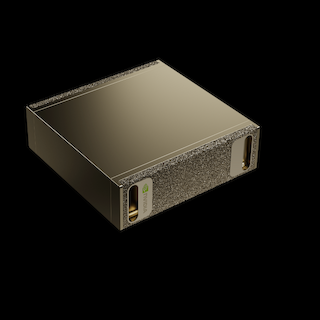

DGX Spark: Die persönliche KI-Fabrik

Der NVIDIA DGX Spark (früher bekannt als Project DIGITS) bringt Supercomputer-Leistung auf den Schreibtisch. Angetrieben vom GB10 Grace Blackwell Superchip liefert er bis zu 1 PetaFLOP KI-Leistung und kann Modelle mit bis zu 200 Milliarden Parametern lokal ausführen.

Besonders spannend: Bis zu vier DGX Spark können jetzt zu einem Cluster verbunden werden – ein "Desktop-Rechenzentrum" für Entwicklerteams.

Relevanz für die Praxis:

- Entwickler und Data Scientists bekommen eine Umgebung, in der sie KI-Modelle lokal entwickeln und testen können – ohne Cloud-Kosten und ohne Datenschutzrisiken.

- Mit vorinstalliertem NVIDIA AI Software-Stack und Support für Tools wie Ollama, LM Studio und vLLM ist man sofort produktiv.

- Perfekt für erste Experimente mit agentischer KI – die entwickelten Agenten lassen sich später nahtlos in größere Umgebungen migrieren.

RTX PRO 4500 Blackwell Server Edition

Für den produktiven Einsatz im Rechenzentrum oder am Edge hat NVIDIA die RTX PRO 4500 Blackwell Server Edition vorgestellt. In einem kompakten Single-Slot-Format (165 Watt) liefert sie:

- Bis zu 100x Leistung bei Vision-KI im Vergleich zu CPU-Servern

- Bis zu 50x Leistung bei Vektordatenbanken

- 10x bessere Performance bei kleinen Sprachmodellen im Vergleich zur Vorgängergeneration

Das Besondere: Die Karte unterstützt vGPU 20.0 und Multi-Instance-GPU (MIG) – ideal für virtualisierte Umgebungen und flexible Ressourcenzuteilung.

Für die Unternehmenspraxis bedeutet das:

- Leistungsstarke KI-Beschleuniger für bestehende Rechenzentren – ohne komplette Infrastruktur umbauen zu müssen.

- Ideal für Edge-Szenarien, wo Platz und Kühlung begrenzt sind.

- Perfekt kombinierbar mit modernen Storage-Lösungen für durchgängige KI-Pipelines.

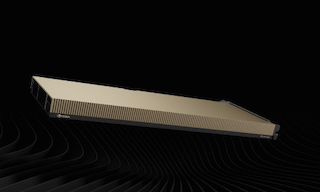

Ein Blick nach vorn: Mit der Vera Rubin Plattform hat NVIDIA die nächste Generation der KI-Infrastruktur vorgestellt. Die vollständig flüssigkeitsgekühlte Rack-Architektur vereint 72 Rubin GPUs und 36 Vera CPUs in einem System und verspricht eine 10-fach höhere Leistung pro Watt.

Für Unternehmen, die langfristig planen, ist das eine wichtige Orientierung: Die Technologie bleibt skalierbar – wer heute in die richtigen Plattformen investiert, kann morgen problemlos nachlegen.

Wer an Robotik, autonome Systeme oder industrielle Steuerung denkt, für den gab es ebenfalls wichtige Neuigkeiten:

- NVIDIA IGX Thor ist jetzt allgemein verfügbar – eine industrietaugliche Plattform für Echtzeit-KI am Edge, mit funktionaler Sicherheit für medizinische und industrielle Anwendungen.

- Die Cosmos-Weltmodelle und die Newton-Physik-Engine (entwickelt mit Google DeepMind und Disney) ermöglichen Robotern das Verständnis physikalischer Zusammenhänge und realistische Simulationen.

Autonome Systeme in der Fertigung, Logistik oder Raumfahrt bekommen damit eine leistungsfähige, sichere Plattform – und Simulation und Realität wachsen enger zusammen.

Ohne Daten keine KI. Die NVIDIA BlueField-4 STX Storage-Architektur bringt die Rechenleistung näher an die Daten und beseitigt Engpässe, die bei großen KI-Workloads oft entstehen.

Zusammen mit Partnern wie DDN, NetApp, VAST Data und WEKA entstehen durchgängige Lösungen, die von der Datenerfassung bis zur Modellbereitstellung alles aus einer Hand bieten.