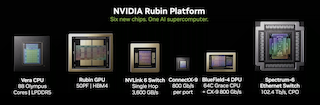

Das weltweit erste KI-Supercomputer-Ökosystem für Billionen-Parameter-Modelle

Erleben Sie den nächsten Evolutionsschritt der künstlichen Intelligenz mit der NVIDIA Rubin-Plattform. Durch extremes Co-Design von sechs spezialisierten Chips bietet Rubin eine bis zu 10-fach geringere Inferenz-Latenz und setzt neue Maßstäbe in der Effizienz von KI-Fabriken.

Die NVIDIA Rubin-Plattform ist nicht nur eine neue GPU-Generation, sondern eine voll integrierte Architektur für die Ära der „Agentic AI“. Durch die nahtlose Verschmelzung von Rechenleistung, Vernetzung und Speicher ermöglicht Rubin den Betrieb von Modellen mit über 50 Billionen Parametern bei gleichzeitig drastischer Senkung der Betriebskosten und des Energieverbrauchs.

Agentic AI & Autonome Systeme: Optimiert für KI-Agenten, die komplexe Ketten von Schlussfolgerungen (Reasoning) in Echtzeit durchführen.

Large-Context Reasoning: Ideal für Anwendungen mit massiven Kontext-Fenstern, wie die Analyse ganzer Gesetzestexte oder Code-Repositorys.

Enterprise AI Factories: Skalierbare Infrastruktur für Hyperscaler und Unternehmen, die eigene Mixture-of-Experts (MoE) Modelle trainieren.

Wissenschaftliche Simulationen: Extreme Rechenleistung für Klimaforschung, Genomik und Materialwissenschaften.

Rubin vs. Blackwell

Die folgende Gegenüberstellung verdeutlicht den technologischen Sprung von der aktuellen Blackwell-Architektur hin zur neuen Vera Rubin Plattform. Während Blackwell den Grundstein für multimodale KI legte, ist Rubin gezielt darauf optimiert, die Grenzen des Agentic Reasoning zu verschieben. Durch den Einsatz von 3nm-Fertigungsprozessen und HBM4-Speichertechnologie erreichen wir eine neue Dimension der Datendurchsatzrate und Energieeffizienz pro Rechenoperation.

| Merkmal | NVIDIA Rubin | NVIDIA Blackwell (B200) |

|---|---|---|

| Architektur-Fokus | Agentic Reasoning / MoE | Video / Multimodal |

| Fertigungsprozess | TSMC 3nm | TSMC 4nm (Multi-Die) |

| Speichertechnologie | HBM4 (bis zu 288GB) | HBM3e (bis zu 192GB) |

| Speicherbandbreite | Bis zu 22 TB/s | Bis zu 8 TB/s |

| Interconnect | NVLink 6 (3.6 TB/s) | NVLink 5 (1.8 TB/s) |

| Modellgröße (Support) | 50T+ Parameter | 10T Parameter |

| Kühlung | 100% Liquid Immersion | Liquid / Air |

Vera CPU

Die Vera CPU nutzt 88 spezialisierte Olympus Cores, um Datenströme und Kontrollflüsse zu orchestrieren. Sie ist das Gehirn, das sicherstellt, dass die GPUs in einer KI-Fabrik niemals leerlaufen.

Rubin GPU

Mit massiver FP4-Leistung (50 Petaflops) und der Integration von HBM4 ist die Rubin GPU speziell für Transformer-Workloads der nächsten Generation ausgelegt, die bisher unerreichte Speicherbandbreiten erfordern.

NVLink 6

Die sechste Generation des NVLink Switches fungiert als lokales Nervensystem. Mit 3,6 TB/s Bandbreite agieren verbundene GPUs wie ein einziger, riesiger Prozessor.

BlueField-4 DPU

Ein technologisches Highlight: Das Dual-Die-Paket kombiniert eine 64-Core Grace CPU mit einem ConnectX-9 Chip. Dies ermöglicht es, die KI-Fabrik sicher zu betreiben und Datenbewegungen hochgradig effizient zu steuern.

ConnectX-9

Der NVIDIA ConnectX-9 ist die hochperformante Netzwerkschnittstelle am Endpunkt. Mit einer Durchsatzrate von 800 Gb/s pro Port bietet er die notwendige niedrige Latenz, um Daten effizient zwischen den Rechenknoten der KI-Fabrik zu bewegen. Er bildet das Rückgrat für das "Scale-out", also die Vernetzung tausender GPUs zu einem zusammenhängenden System.

Spectrum-6 Ethernet Switch

Der Spectrum-6 ist der weltweit erste Ethernet-Switch, der konsequent auf Co-Packaged Optics (CPO) setzt. Mit einer gewaltigen Gesamtkapazität von 102,4 Tb/s ermöglicht er eine massive Skalierung der Netzwerkinfrastruktur. Durch die direkte Integration optischer Komponenten wird nicht nur die Energieeffizienz drastisch gesteigert, sondern auch die Zuverlässigkeit in großflächigen Rechenzentrums-Installationen maximiert.

Sie brauchen mehr? Passende Hardware zum Thema AI-Training

Unsere leistungsfähigen Speicherlösungen bieten hohe Kapazität und Geschwindigkeit, um große Datenmengen effizient zu speichern und abzurufen. Perfekt für die Anforderungen von Big Data und maschinellem Lernen.

Die Software-Plattform für sichere und skalierbare KI-Anwendungen.

Die schlüsselfertige Rechenzentrumslösung für maximale KI-Skalierung.

Erster Schritt Kontaktieren Sie sysGen

- Für wen ist die Rubin-Plattform gedacht?

Primär für Unternehmen und Forschungseinrichtungen, die mit Billionen-Parameter-Modellen arbeiten oder komplexe, autonome KI-Agenten in großem Stil bereitstellen wollen.

- Wann ist NVIDIA Rubin verfügbar?

Erste Cloud-Instanzen und Systeme werden für die zweite Jahreshälfte 2026 erwartet. Die Software-Vorbereitung kann bereits heute auf Blackwell-Systemen beginnen.

- Wie verbessert Rubin die Energieeffizienz?

Trotz hoher TDP-Werte pro GPU bietet Rubin eine 4-fach höhere Performance-pro-Watt im Vergleich zur Vorgängergeneration, was die Total Cost of Ownership (TCO) massiv senkt.

- Ist Rubin mit bestehender Software kompatibel?

Ja, Rubin unterstützt den vollen NVIDIA Software-Stack, einschließlich CUDA, TensorRT und die NVIDIA AI Enterprise Suite.